合并数据集

pandas对象中的数据可以通过一些内置的方式进行合并:

·pandas.merge可根据一个或多个键将不同DataFrame中的行连接起来。SQL或其他关系型数据库的用户对此应该会比较熟悉,因为它实现的就是数据库的连接操作。

·pandas.concat可以沿着一条轴将多个对象堆叠到一起。

·实例方法combine_first可以将重复数据编接在一起,用一个对象中的值填充另一个对象中的缺失值。译注1

我将分别对它们进行讲解,并给出一些例子。本书剩余部分的示例中将经常用到它们。

数据库风格的DataFrame合并

数据集的合并(merge)或连接(join)运算是通过一个或多个键将行链接起来的。这些运算是关系型数据库的核心。pandas的merge函数是对数据应用这些算法的主要切入点。

我们以一个简单的例子开始:

- In [15]: df1 = DataFrame({'key': ['b', 'b', 'a', 'c', 'a', 'a', 'b'],

- ...: 'data1': range(7)})

- In [16]: df2 = DataFrame({'key': ['a', 'b', 'd'],

- ...: 'data2': range(3)})

- In [17]: df1

- Out[17]:

- data1 key

- 0 0 b

- 1 1 b

- 2 2 a

- 3 3 c

- 4 4 a

- 5 5 a

- 6 6 b

- In [18]: df2

- Out[18]:

- data2 key

- 0 0 a

- 1 1 b

- 2 2 d

这是一种多对一的合并。df1中的数据有多个被标记为a和b的行,而df2中key列的每个值则仅对应一行。对这些对象调用merge即可得到:

- In [19]: pd.merge(df1, df2)

- Out[19]:

- data1 key data2

- 0 2 a 0

- 1 4 a 0

- 2 5 a 0

- 3 0 b 1

- 4 1 b 1

- 5 6 b 1

注意,我并没有指明要用哪个列进行连接。如果没有指定,merge就会将重叠列的列名当做键。不过,最好显式指定一下:

- In [20]: pd.merge(df1, df2, on='key')

- Out[20]:

- data1 key data2

- 0 2 a 0

- 1 4 a 0

- 2 5 a 0

- 3 0 b 1

- 4 1 b 1

- 5 6 b 1

如果两个对象的列名不同,也可以分别进行指定:

- In [21]: df3 = DataFrame({'lkey': ['b', 'b', 'a', 'c', 'a', 'a', 'b'],

- ...: 'data1': range(7)})

- In [22]: df4 = DataFrame({'rkey': ['a', 'b', 'd'],

- ...: 'data2': range(3)})

- In [23]: pd.merge(df3, df4, left_on='lkey', right_on='rkey')

- Out[23]:

- data1 lkey data2 rkey

- 0 2 a 0 a

- 1 4 a 0 a

- 2 5 a 0 a

- 3 0 b 1 b

- 4 1 b 1 b

- 5 6 b 1 b

可能你已经注意到了,结果里面c和d以及与之相关的数据消失了。默认情况下,merge做的是"inner"连接;结果中的键是交集。其他方式还有"left"、"right"以及"outer"。外连接求取的是键的并集,组合了左连接和右连接的效果:

- In [24]: pd.merge(df1, df2, how='outer')

- Out[24]:

- data1 key data2

- 0 2 a 0

- 1 4 a 0

- 2 5 a 0

- 3 0 b 1

- 4 1 b 1

- 5 6 b 1

- 6 3 c NaN

- 7 NaN d 2

多对多的合并操作非常简单,无需额外的工作。如下所示:

- In [25]: df1 = DataFrame({'key': ['b', 'b', 'a', 'c', 'a', 'b'],

- ...: 'data1': range(6)})

- In [26]: df2 = DataFrame({'key': ['a', 'b', 'a', 'b', 'd'],

- ...: 'data2': range(5)})

- In [27]: df1

- Out[27]:

- data1 key

- 0 0 b

- 1 1 b

- 2 2 a

- 3 3 c

- 4 4 a

- 5 5 b

- In [28]: df2

- Out[28]:

- data2 key

- 0 0 a

- 1 1 b

- 2 2 a

- 3 3 b

- 4 4 d

- In [29]: pd.merge(df1, df2, on='key', how='left')

- Out[29]:

- data1 key data2

- 0 2 a 0

- 1 2 a 2

- 2 4 a 0

- 3 4 a 2

- 4 0 b 1

- 5 0 b 3

- 6 1 b 1

- 7 1 b 3

- 8 5 b 1

- 9 5 b 3

- 10 3 c NaN

多对多连接产生的是行的笛卡尔积。由于左边的DataFrame有3个"b"行,右边的有2个,所以最终结果中就有6个"b"行。连接方式只影响出现在结果中的键:

- In [30]: pd.merge(df1, df2, how='inner')

- Out[30]:

- data1 key data2

- 0 2 a 0

- 1 2 a 2

- 2 4 a 0

- 3 4 a 2

- 4 0 b 1

- 5 0 b 3

- 6 1 b 1

- 7 1 b 3

- 8 5 b 1

- 9 5 b 3

要根据多个键进行合并,传入一个由列名组成的列表即可:

- In [31]: left = DataFrame({'key1': ['foo', 'foo', 'bar'],

- ...: 'key2': ['one', 'two', 'one'],

- ...: 'lval': [1, 2, 3]})

- In [32]: right = DataFrame({'key1': ['foo', 'foo', 'bar', 'bar'],

- ...: 'key2': ['one', 'one', 'one', 'two'],

- ...: 'rval': [4, 5, 6, 7]})

- In [33]: pd.merge(left, right, on=['key1', 'key2'], how='outer')

- Out[33]:

- key1 key2 lval rval

- 0 bar one 3 6

- 1 bar two NaN 7

- 2 foo one 1 4

- 3 foo one 1 5

- 4 foo two 2 NaN

结果中会出现哪些键组合取决于所选的合并方式,你可以这样来理解:多个键形成一系列元组,并将其当做单个连接键(当然,实际上并不是这么回事)。

警告: 在进行列-列连接时,DataFrame对象中的索引会被丢弃。

对于合并运算需要考虑的最后一个问题是对重复列名的处理。虽然你可以手工处理列名重叠的问题(稍后将会介绍如何重命名轴标签),但merge有一个更实用的suffixes选项,用于指定附加到左右两个DataFrame对象的重叠列名上的字符串:

- In [34]: pd.merge(left, right, on='key1')

- Out[34]:

- key1 key2_x lval key2_y rval

- 0 bar one 3 one 6

- 1 bar one 3 two 7

- 2 foo one 1 one 4

- 3 foo one 1 one 5

- 4 foo two 2 one 4

- 5 foo two 2 one 5

- In [35]: pd.merge(left, right, on='key1', suffixes=('_left', '_right'))

- Out[35]:

- key1 key2_left lval key2_right rval

- 0 bar one 3 one 6

- 1 bar one 3 two 7

- 2 foo one 1 one 4

- 3 foo one 1 one 5

- 4 foo two 2 one 4

- 5 foo two 2 one 5

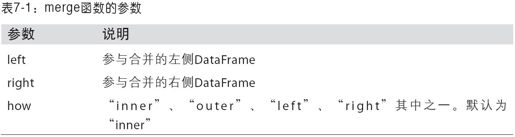

merge的参数请参见表7-1。索引上的连接将在下一节中讲解。

索引上的合并

有时候,DataFrame中的连接键位于其索引中。在这种情况下,你可以传入left_index=True或right_index=True(或两个都传)以说明索引应该被用作连接键:

- In [36]: left1 = DataFrame({'key': ['a', 'b', 'a', 'a', 'b', 'c'],

- ....: 'value': range(6)})

- In [37]: right1 = DataFrame({'group_val': [3.5, 7]}, index=['a', 'b'])

- In [38]: left1

- Out[38]:

- key value

- 0 a 0

- 1 b 1

- 2 a 2

- 3 a 3

- 4 b 4

- 5 c 5

- In [39]: right1

- Out[39]:

- group_val

- a 3.5

- b 7.0

- In [40]: pd.merge(left1, right1, left_on='key', right_index=True)

- Out[40]:

- key value group_val

- 0 a 0 3.5

- 2 a 2 3.5

- 3 a 3 3.5

- 1 b 1 7.0

- 4 b 4 7.0

由于默认的merge方法是求取连接键的交集,因此你可以通过外连接的方式得到它们的并集:

- In [41]: pd.merge(left1, right1, left_on='key', right_index=True, how='outer')

- Out[41]:

- key value group_val

- 0 a 0 3.5

- 2 a 2 3.5

- 3 a 3 3.5

- 1 b 1 7.0

- 4 b 4 7.0

- 5 c 5 NaN

对于层次化索引的数据,事情就有点复杂了:

- In [42]: lefth = DataFrame({'key1': ['Ohio', 'Ohio', 'Ohio', 'Nevada', 'Nevada'],

- ...: 'key2': [2000, 2001, 2002, 2001, 2002],

- ...: 'data': np.arange(5.)})

- In [43]: righth = DataFrame(np.arange(12).reshape((6, 2)),

- ...: index=[['Nevada', 'Nevada', 'Ohio', 'Ohio', 'Ohio', 'Ohio'],

- ...: [2001, 2000, 2000, 2000, 2001, 2002]],

- ...: columns=['event1', 'event2'])

- In [44]: lefth

- Out[44]:

- data key1 key2

- 0 0 Ohio 2000

- 1 1 Ohio 2001

- 2 2 Ohio 2002

- 3 3 Nevada 2001

- 4 4 Nevada 2002

- In [45]: righth

- Out[45]:

- event1 event2

- Nevada 2001 0 1

- 2000 2 3

- Ohio 2000 4 5

- 2000 6 7

- 2001 8 9

- 2002 10 11

这种情况下,你必须以列表的形式指明用作合并键的多个列(注意对重复索引值的处理):

- In [46]: pd.merge(lefth, righth, left_on=['key1', 'key2'], right_index=True)

- Out[46]:

- data key1 key2 event1 event2

- 3 3 Nevada 2001 0 1

- 0 0 Ohio 2000 4 5

- 0 0 Ohio 2000 6 7

- 1 1 Ohio 2001 8 9

- 2 2 Ohio 2002 10 11

- In [47]: pd.merge(lefth, righth, left_on=['key1', 'key2'],

- ...: right_index=True, how='outer')

- Out[47]:

- data key1 key2 event1 event2

- 4 NaN Nevada 2000 2 3

- 3 3 Nevada 2001 0 1

- 4 4 Nevada 2002 NaN NaN

- 0 0 Ohio 2000 4 5

- 0 0 Ohio 2000 6 7

- 1 1 Ohio 2001 8 9

- 2 2 Ohio 2002 10 11

同时使用合并双方的索引也没问题:

- In [48]: left2 = DataFrame([[1., 2.], [3., 4.], [5., 6.]], index=['a', 'c', 'e'],

- ...: columns=['Ohio', 'Nevada'])

- In [49]: right2 = DataFrame([[7., 8.], [9., 10.], [11., 12.], [13, 14]],

- ...: index=['b', 'c', 'd', 'e'], columns=['Missouri', 'Alabama'])

- In [50]: left2

- Out[50]:

- Ohio Nevada

- a 1 2

- c 3 4

- e 5 6

- In [51]: right2

- Out[51]:

- Missouri Alabama

- b 7 8

- c 9 10

- d 11 12

- e 13 14

- In [52]: pd.merge(left2, right2, how='outer', left_index=True, right_index=True)

- Out[52]:

- Ohio Nevada Missouri Alabama

- a 1 2 NaN NaN

- b NaN NaN 7 8

- c 3 4 9 10

- d NaN NaN 11 12

- e 5 6 13 14

DataFrame还有一个join实例方法,它能更为方便地实现按索引合并。它还可用于合并多个带有相同或相似索引的DataFrame对象,而不管它们之间有没有重叠的列。在上面那个例子中,我们可以编写:

- In [53]: left2.join(right2, how='outer')

- Out[53]:

- Ohio Nevada Missouri Alabama

- a 1 2 NaN NaN

- b NaN NaN 7 8

- c 3 4 9 10

- d NaN NaN 11 12

- e 5 6 13 14

由于一些历史原因(早期版本的pandas),DataFrame的join方法是在连接键上做左连接。它还支持参数DataFrame的索引跟调用者DataFrame的某个列之间的连接:

- In [54]: left1.join(right1, on='key')

- Out[54]:

- key value group_val

- 0 a 0 3.5

- 1 b 1 7.0

- 2 a 2 3.5

- 3 a 3 3.5

- 4 b 4 7.0

- 5 c 5 NaN

最后,对于简单的索引合并,你还可以向join传入一组DataFrame(后面我们会介绍更为通用的concat函数,它也能实现此功能):

- In [55]: another = DataFrame([[7., 8.], [9., 10.], [11., 12.], [16., 17.]],

- ...: index=['a', 'c', 'e', 'f'], columns=['New York', 'Oregon'])

- In [56]: left2.join([right2, another])

- Out[56]:

- Ohio Nevada Missouri Alabama New York Oregon

- a 1 2 NaN NaN 7 8

- c 3 4 9 10 9 10

- e 5 6 13 14 11 12

- In [57]: left2.join([right2, another], how='outer')

- Out[57]:

- Ohio Nevada Missouri Alabama New York Oregon

- a 1 2 NaN NaN 7 8

- b NaN NaN 7 8 NaN NaN

- c 3 4 9 10 9 10

- d NaN NaN 11 12 NaN NaN

- e 5 6 13 14 11 12

- f NaN NaN NaN NaN 16 17

轴向连接

另一种数据合并运算也被称作连接(concatenation)、绑定(binding)或堆叠(stacking)。NumPy有一个用于合并原始NumPy数组的concatenation函数:

- In [58]: arr = np.arange(12).reshape((3, 4))

- In [59]: arr

- Out[59]:

- array([[ 0, 1, 2, 3],

- [ 4, 5, 6, 7],

- [ 8, 9, 10, 11]])

- In [60]: np.concatenate([arr, arr], axis=1)

- Out[60]:

- array([[ 0, 1, 2, 3, 0, 1, 2, 3],

- [ 4, 5, 6, 7, 4, 5, 6, 7],

- [ 8, 9, 10, 11, 8, 9, 10, 11]])

对于pandas对象(如Series和DataFrame),带有标签的轴使你能够进一步推广数组的连接运算。具体点说,你还需要考虑以下这些东西:

·如果各对象其他轴上的索引不同,那些轴应该是做并集还是交集?

·结果对象中的分组需要各不相同吗?

·用于连接的轴重要吗?

pandas的concat函数提供了一种能够解决这些问题的可靠方式。我将给出一些例子来讲解其使用方式。假设有三个没有重叠索引的Series:

- In [61]: s1 = Series([0, 1], index=['a', 'b'])

- In [62]: s2 = Series([2, 3, 4], index=['c', 'd', 'e'])

- In [63]: s3 = Series([5, 6], index=['f', 'g'])

对这些对象调用concat可以将值和索引粘合在一起:

- In [64]: pd.concat([s1, s2, s3])

- Out[64]:

- a 0

- b 1

- c 2

- d 3

- e 4

- f 5

- g 6

默认情况下,concat是在axis=0上工作的,最终产生一个新的Series。如果传入axis=1,则结果就会变成一个DataFrame(axis=1是列):

- In [65]: pd.concat([s1, s2, s3], axis=1)

- Out[65]:

- 0 1 2

- a 0 NaN NaN

- b 1 NaN NaN

- c NaN 2 NaN

- d NaN 3 NaN

- e NaN 4 NaN

- f NaN NaN 5

- g NaN NaN 6

这种情况下,另外一条轴上没有重叠,从索引的有序并集(外连接)上就可以看出来。传入join='inner'即可得到它们的交集:

- In [66]: s4 = pd.concat([s1 * 5, s3])

- In [67]: pd.concat([s1, s4], axis=1) In [68]: pd.concat([s1, s4], axis=1, join='inner')

- Out[67]: Out[68]:

- 0 1 0 1

- a 0 0 a 0 0

- b 1 5 b 1 5

- f NaN 5

- g NaN 6

你可以通过join_axes指定要在其他轴上使用的索引:

- In [69]: pd.concat([s1, s4], axis=1, join_axes=[['a', 'c', 'b', 'e']])

- Out[69]:

- 0 1

- a 0 0

- c NaN NaN

- b 1 5

- e NaN NaN

不过有个问题,参与连接的片段在结果中区分不开。假设你想要在连接轴上创建一个层次化索引。使用keys参数即可达到这个目的:

- In [70]: result = pd.concat([s1, s1, s3], keys=['one', 'two', 'three'])

- In [71]: result

- Out[71]:

- one a 0

- b 1

- two a 0

- b 1

- three f 5

- g 6

- # 稍后将详细讲解unstack函数

- In [72]: result.unstack()

- Out[72]:

- a b f g

- one 0 1 NaN NaN

- two 0 1 NaN NaN

- three NaN NaN 5 6

如果沿着axis=1对Series进行合并,则keys就会成为DataFrame的列头:

- In [73]: pd.concat([s1, s2, s3], axis=1, keys=['one', 'two', 'three'])

- Out[73]:

- one two three

- a 0 NaN NaN

- b 1 NaN NaN

- c NaN 2 NaN

- d NaN 3 NaN

- e NaN 4 NaN

- f NaN NaN 5

- g NaN NaN 6

同样的逻辑对DataFrame对象也是一样:

- In [74]: df1 = DataFrame(np.arange(6).reshape(3, 2), index=['a', 'b', 'c'],

- ...: columns=['one', 'two'])

- In [75]: df2 = DataFrame(5 + np.arange(4).reshape(2, 2), index=['a', 'c'],

- ...: columns=['three', 'four'])

- In [76]: pd.concat([df1, df2], axis=1, keys=['level1', 'level2'])

- Out[76]:

- level1 level2

- one two three four

- a 0 1 5 6

- b 2 3 NaN NaN

- c 4 5 7 8

如果传入的不是列表而是一个字典,则字典的键就会被当做keys选项的值:

- In [77]: pd.concat({'level1': df1, 'level2': df2}, axis=1)

- Out[77]:

- level1 level2

- one two three four

- a 0 1 5 6

- b 2 3 NaN NaN

- c 4 5 7 8

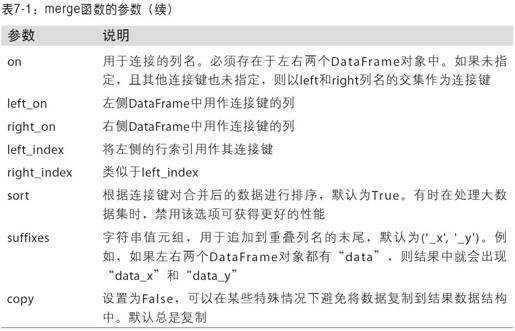

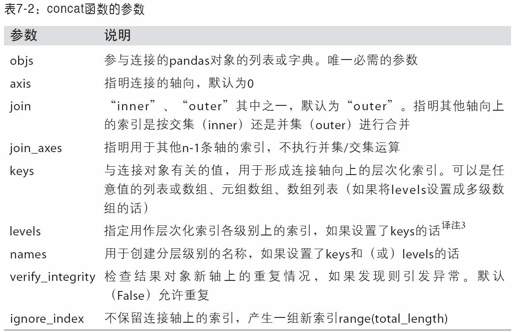

此外还有两个用于管理层次化索引创建方式的参数(参见表7-2):

- In [78]: pd.concat([df1, df2], axis=1, keys=['level1', 'level2'],

- ...: names=['upper', 'lower'])

- Out[78]:

- upper level1 level2

- lower one two three four

- a 0 1 5 6

- b 2 3 NaN NaN

- c 4 5 7 8

最后一个需要考虑的问题是,跟当前分析工作无关的DataFrame行索引译注2:

- In [79]: df1 = DataFrame(np.random.randn(3, 4), columns=['a', 'b', 'c', 'd'])

- In [80]: df2 = DataFrame(np.random.randn(2, 3), columns=['b', 'd', 'a'])

- In [81]: df1

- Out[81]:

- a b c d

- 0 -0.204708 0.478943 -0.519439 -0.555730

- 1 1.965781 1.393406 0.092908 0.281746

- 2 0.769023 1.246435 1.007189 -1.296221

- In [82]: df2

- Out[82]:

- b d a

- 0 0.274992 0.228913 1.352917

- 1 0.886429 -2.001637 -0.371843

在这种情况下,传入ignore_index=True即可:

- In [83]: pd.concat([df1, df2], ignore_index=True)

- Out[83]:

- a b c d

- 0 -0.204708 0.478943 -0.519439 -0.555730

- 1 1.965781 1.393406 0.092908 0.281746

- 2 0.769023 1.246435 1.007189 -1.296221

- 3 1.352917 0.274992 NaN 0.228913

- 4 -0.371843 0.886429 NaN -2.001637

译注3:就是外层级别的索引。

合并重叠数据

还有一种数据组合问题不能用简单的合并(merge)或连接(concatenation)运算来处理。比如说,你可能有索引全部或部分重叠的两个数据集。给这个例子增加一点启发性,我们使用NumPy的where函数,它用于表达一种矢量化的if-else:

- In [84]: a = Series([np.nan, 2.5, np.nan, 3.5, 4.5, np.nan],

- ...: index=['f', 'e', 'd', 'c', 'b', 'a'])

- In [85]: b = Series(np.arange(len(a), dtype=np.float64),

- ...: index=['f', 'e', 'd', 'c', 'b', 'a'])

- In [86]: b[-1] = np.nan

- In [87]: a In [88]: b In [89]: np.where(pd.isnull(a), b, a)

- Out[87]: Out[88]: Out[89]:

- f NaN f 0 f 0.0

- e 2.5 e 1 e 2.5

- d NaN d 2 d 2.0

- c 3.5 c 3 c 3.5

- b 4.5 b 4 b 4.5

- a NaN a NaN a NaN

Series有一个combine_first方法,实现的也是一样的功能,而且会进行数据对齐:

- In [90]: b[:-2].combine_first(a[2:])

- Out[90]:

- a NaN

- b 4.5

- c 3.0

- d 2.0

- e 1.0

- f 0.0

对于DataFrame,combine_first自然也会在列上做同样的事情,因此你可以将其看做:用参数对象中的数据为调用者对象的缺失数据“打补丁”:

- In [91]: df1 = DataFrame({'a': [1., np.nan, 5., np.nan],

- ...: 'b': [np.nan, 2., np.nan, 6.],

- ...: 'c': range(2, 18, 4)})

- In [92]: df2 = DataFrame({'a': [5., 4., np.nan, 3., 7.],

- ...: 'b': [np.nan, 3., 4., 6., 8.]})

- In [93]: df1.combine_first(df2)

- Out[93]:

- a b c

- 0 1 NaN 2

- 1 4 2 6

- 2 5 4 10

- 3 3 6 14

- 4 7 8 NaN

译注1:通俗来说,差不多就是数据库的全外连接(注意“差不多”和“全外连接”这两个词)。简单地说,就是先从第一个对象中选值,不行就再去第二个对象中选值。

译注2:也就是说那些行索引是无意义的。